熱點追不上我,因為我讓 AI 先跑了:一位內容創作者的「作弊」實錄

曾經,我以為追熱點是場百米衝刺。你需要眼觀六路,耳聽八方,在社交媒體和新聞網站的海洋裡狗刨,搶在所有人前面憋出一篇「剛剛!」的文章。結果往往是,你剛按下發布鍵,就發現隔壁已經上了熱搜第二,而你,連個水花都沒濺起來。直到我放棄了「追」,開始讓系統「抓」。

熱點不是追來的,是算出來的

我們總說「熱點」,但「熱」的標準是什麼?是微博熱搜榜前五十?還是知乎熱榜前十?這些榜單本身已經是結果,是別人已經煮沸了的水。等你跳進去,只能算個溫湯。真正的「熱」,是那些正在被大量搜索,但還沒有被充分滿足的查詢意圖。

我試過手動盯盤。用各種工具監控關鍵字趨勢,設定 Google Alerts,甚至養了幾個爬蟲小腳本。效果嘛,不能說沒有。我成功預測過幾次科技產品的發布會日期,也寫過幾篇在圈內小範圍傳播的行業分析。但問題在於,這種模式不可持續,且極度依賴我的個人狀態。我累了、病了、去度了個假,熱點視窗就啪一聲關上了。我的內容產出曲線,像極了我的心電圖——時而高峰,時而長期平坦。

後我意識到,問題的核心在於,我試圖用一個人的生物感知系統,去對抗整個互聯網的數據洪流。這就像試圖用體溫計去測量火山熔岩的溫度,不是工具不對,是維度錯了。

當 AI 開始「閱讀」全網情緒

轉變發生在我把「資訊源」從「我看到的」變成「系統抓取的」之後。我不再只看成形的新聞,而是開始關注那些原始的、正在萌芽的搜尋需求。

比如,去年有段時間,矽谷突然開始討論一種新的開源模型架構。主流科技媒體還沒大規模報導,但我在一些開發者論壇和 Reddit 的特定板塊裡,看到了零星但密集的討論。按照舊方法,我得花半天時間研究這個架構的原理、優劣、可能的應用場景,再花半天寫文章。等我的「深度分析」出,早有一打快訊和入門教程把流量分食乾淨了。

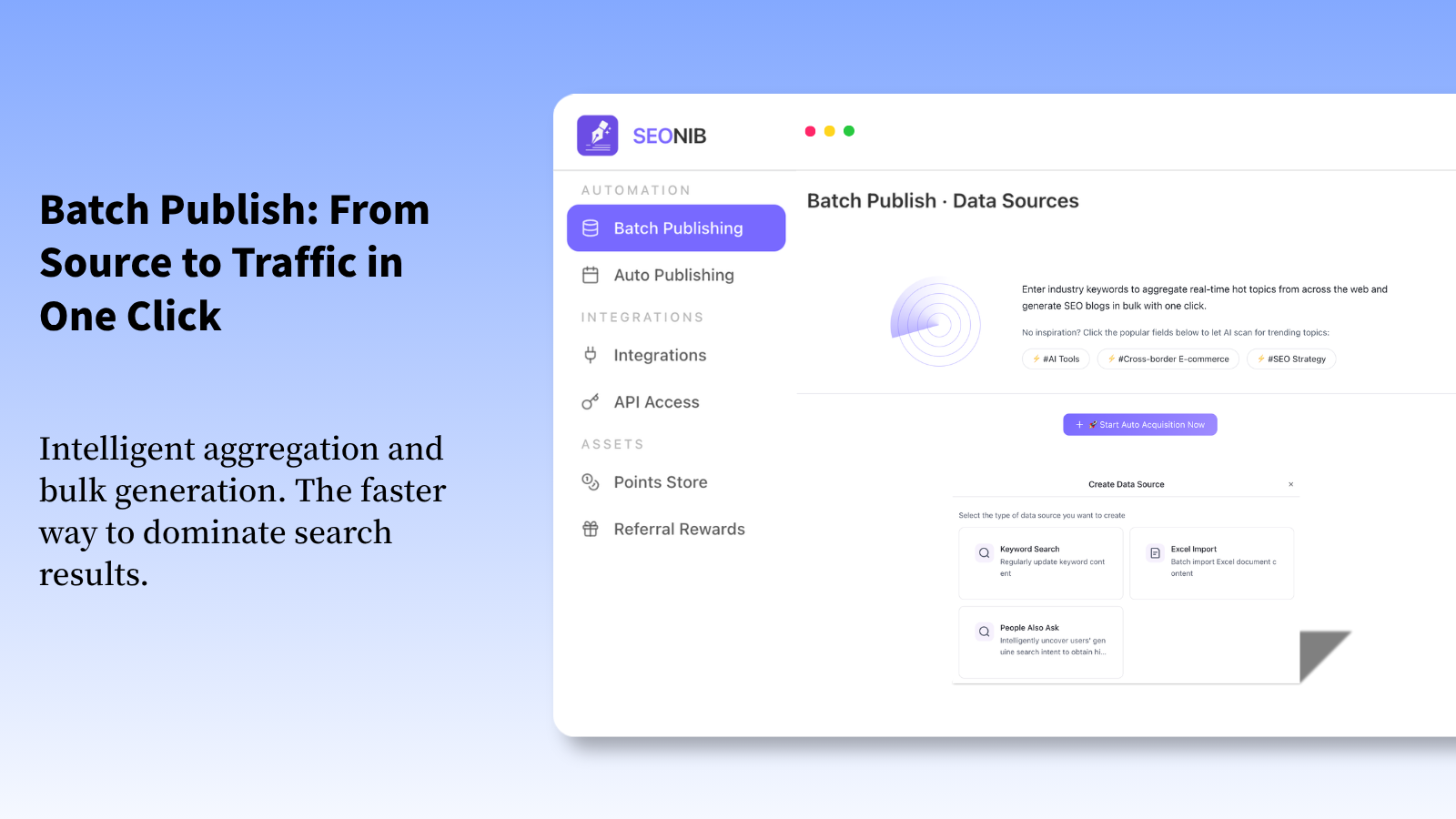

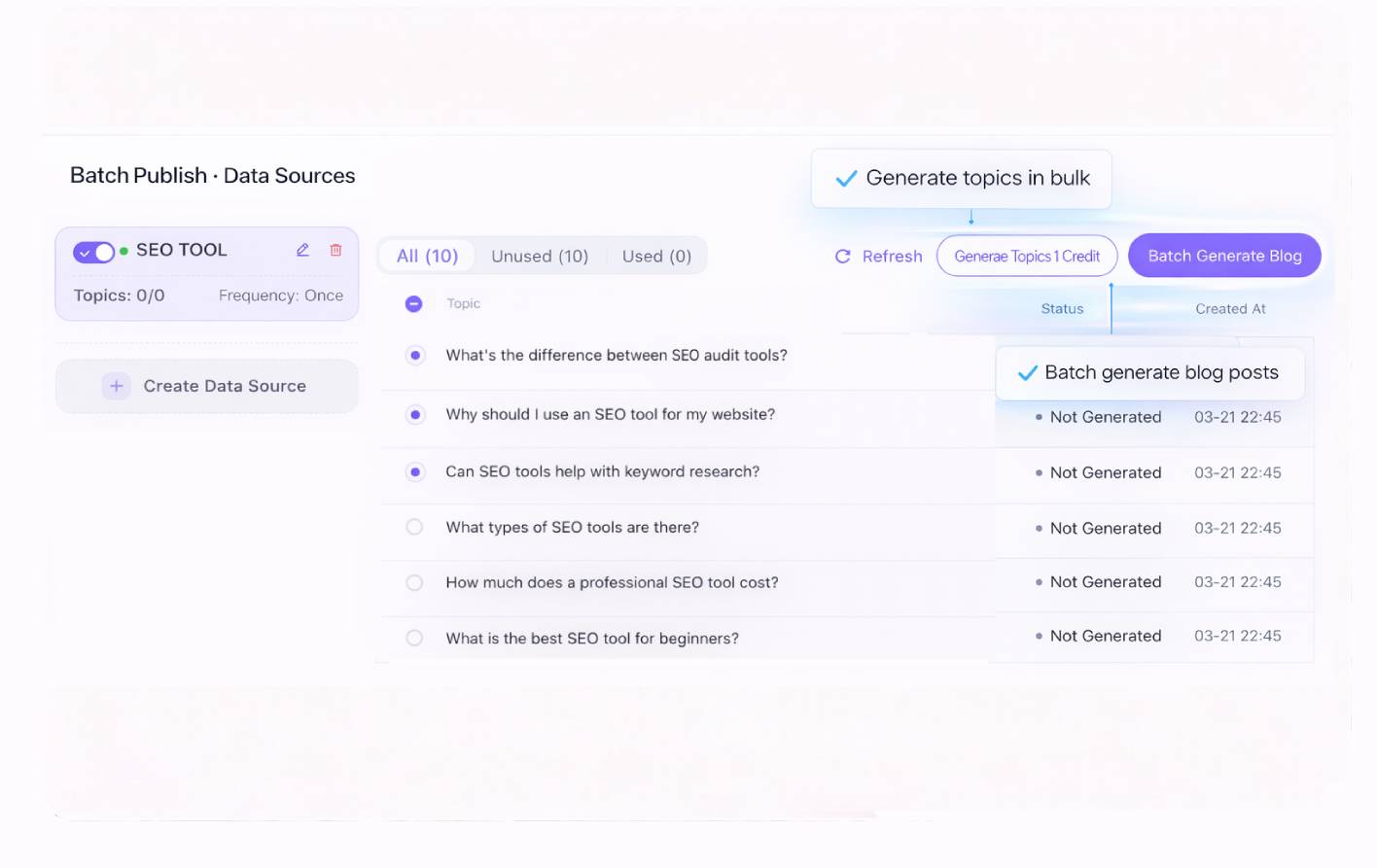

這時,我開始用 SEONIB 這樣的工具。它的邏輯不一樣:它不等待熱點「成形」,而是持續掃描各種公開的問答平台(如 Quora、Stack Exchange)、社群討論、甚至相關長尾關鍵字的搜尋量變化。它不是在「報導新聞」,而是在「捕捉需求」。當它發現圍繞某個技術名詞的「人們也在問」(PAA)問題數量在 24 小時內激增 300%,即使這個詞還沒上任何趨勢榜,它也會判定這是一個正在形成的「熱點」。

SEONIB 給我的第一個震撼是,它推給我的第一個備選主題,就是那個模型架構。附帶的資料是:過去 12 小時,相關長尾問題搜尋量增長 280%,現有高品質內容幾乎為零。它不是在告訴我「發生了什麼」,而是在告訴我「人們想知道什麼但還沒找到答案」。這個視角的轉換,是決定性的。

從「捕捉」到「出文」:一場與時間的賽跑

捕捉到熱點只是第一步,真正的競賽在於內容生產速度。這裡的「快」,不是指胡編亂造、東拼西湊的快,而是在保證資訊準確性和內容結構完整性的前提下,極致的效率。

我過去的流程是:研究(1‑2 小時) → 列提綱(0.5 小時) → 寫作(2‑3 小時) → 排版優化(0.5 小時)。整個流程下來,一個熱點已經涼了半截。更不用說,深夜爆出的熱點,我根本無力回應。

自動化內容生成解決的就是這個「最後一公里」的問題。當我透過 SEONIB 確認一個熱點主題後,我可以直接讓它基於抓取到的核心問題、高關聯關鍵字和競爭內容分析,生成一篇結構完整的草稿。請注意,是「草稿」。我從不認為 AI 能直接生成完美無缺、充滿個人洞見的爆文。它的價值在於,它能在 3 分鐘內,給我一個包含了引言、核心問題解答、技術要點(帶準確數據)、常見誤區、未展望等章節的、搜尋引擎友好的框架。

這相當於,在我和熱點之間,多了一個不知疲倦、速度極快的「助理研究員+初級寫手」。我省下了最耗時的資訊梳理和初稿搭建時間,可以把寶貴的精力集中在:1)核實關鍵資料和事實;2)注入我的個人觀點與行業洞察;3)優化語言,讓它更符合「人」的口味。整個過程從 4‑6 小時壓縮到 30‑45 分鐘。我從一個氣喘吁吁的追趕者,變成了在起點線不遠處等著接力棒的選手。

流量不是結果,是持續的過程

最大的誤解,是認為抓住一個熱點就能帶來一波永久的流量。現實是,熱點流量來得快,去得也快。真正的價值,在於將每一個熱點作為切入點,生產出能持續滿足搜尋需求的內容,並讓這些內容像滾雪球一樣,不斷累積網站的權威性和索引量。

我觀察到的一個有趣現象是,透過這種快速回應機制產出的文章,其初始流量峰值可能不如某些爆款,但它的「長尾效應」非常明顯。因為文章是基於真實、具體的搜尋意圖生成的,它解決了一個確切的問題。所以,當熱點過去,它不會變成死鏈,而是會作為一個常青的知識點,持續從搜尋引擎獲得零散的、但源源不斷的訪問。

我的網站索引頁面數,在採用這種半自動化工作流後,以近乎直線的斜率增長。每一個捕捉到的熱點關鍵字,AI 在生成主文章時,會自動衍生出 5‑10 個相關的長尾關鍵字主題,並建議我後續覆蓋。這就形成了一個內容矩陣:一個熱點事件,可以衍生出一個小的內容集群,共同構建這個話題的權威度。流量,從此不再是「事件驅動」,而是「系統驅動」。

最後的坦誠:工具沒有消滅工作,它重新定義了工作

用了這些工具後,我失業了嗎?恰恰相反,我更忙了。但我忙的內容變了。我從一個被 deadline 驅的「碼字工人」,變成了一個「策略編輯」和「品質總監」。我不再糾結於「今天寫什麼」,而是思考「我們這個月的知識圖譜要覆蓋哪幾個領域」;我不再疲憊地查資料寫初稿,而是更專注地審核、修正、賦予內容靈魂和獨特性。

技術淘汰的不是創作者,而是純粹的「復述者」。當 AI 能瞬間完成資訊整合和初稿搭建時,人類創作者的核心競爭力,就落到了那些 AI(至少目前)還難以企及的地方:獨特的視角、深刻的一線經驗、批判性思維、以及真正打動人心的敘事能力。

所以,別再問我怎麼追熱點了。我追不上,我也不追了。我讓系統去監聽整個互聯網的「心跳」,然後把最有價值的「脈搏」送到我面前。我節省下時間,去做只有我能做的事:思考、判斷,並讓每一篇快速出爐的文章,都真正擁有「人」的溫度。

FAQ

Q: 全自動抓取和生成,內容會不會很同質化?

A: 絕對會,如果你完全放任不管。工具提供的是速度和框架,不是靈魂。我的經驗是,AI 生成的內容是絕佳的「毛坯房」,省去了你打地基、砌牆的時間。但內部的裝修、設計、那些讓人想住下來的細節,必須由你來完成。我通常會修改 30%‑40%,加入個人案例、行業黑話和最新動態。

Q: 這樣快速生產的內容,搜尋引擎真的會喜歡嗎?

A: 搜尋引擎喜歡的是能快速、準確解決使用者問題的內容。如果你的流程是:捕捉真實搜尋需求 → 快速生成高品質解答框架 → 人工注入深度和準確性,那麼搜尋引擎沒有理由不喜歡。這比很多網站用採集器生成的毫無意義的偽原創內容,品質高太多了。關鍵是,你的內容是否真的匹配了搜尋意圖。

Q: 需要很強的技術背景來設定這些自動化流程嗎?

A: 比我最初想像的要簡單得多。現在的 SaaS 工具就像搭積木。以我使用的工具為例,你只需要告訴它你的網站地址、想關注的大致領域(比如「AI 編程工具」「SaaS 成長」),設定好發布頻率,它就開始自動運作了。最技術性的部分,可能就是把 API 金鑰填進去。難點不在技術,而在於你後續的內容策略與編輯工作流如何與之配合。

Q: 這樣做的流量效果到底有多快?

A: 別指望今天用上,明天就爆款。這是一個累積系統。快,體現在單個內容的回應速度上,讓你不錯失時機。但整體流量的增長,是線性的、持續的。我的站點大概在持續運行一個半月後,日均有機搜尋流量開始有可見的、穩定的爬升。它帶來的是一種「細水長流」式的成長,而非賭爆款的刺激。

Q: 對於小團隊或個人創作者,成本划算嗎?

A: 這取決於你如何計算成本。如果只算金錢訂閱費,是一筆開支。但如果算上你節省的時間成本、錯失熱點機會的成本、以及因持續產出而累積的長期數位資產(索引頁面、域名權威度),對於認真想透過內容獲取流量的創作者來說,通常是划算的。你可以先從一個細分領域開始測試,看內容產出和收錄效果,再決定是否擴大範圍。