2026年了,SEO文章還需要自己寫嗎?我的實戰觀察與轉折

我記得是去年年底,團隊裡的内容負責人又一次找我「談心」。主題很老套:內容產出跟不上SEO需求,關鍵字庫越積越多,但人力就那麼多。我們試過擴招,試過外包,甚至試過讓開發同事客串寫手,結果要麼成本飆升,要麼質量滑坡。那感覺就像在跑步機上狂奔,但SEO的流量刻度盤卻動得很慢。

當時我有個很固執的想法:AI寫的東西,能看嗎?更別說去跟那些深耕多年的獨立站、權威媒體競爭排名了。我們試過一些早期的文本生成工具,出來的內容要麼泛泛而談,要麼充滿「正確的廢話」,讀起來像行業詞典的拼接體,缺乏真正的洞察和說服力。用那種內容去投餵Google,感覺就像用塑膠花去參加園藝大賽。

從「堆量」到「求質」的認知轉變

最初的困境是量。我們有一份長長的關鍵字列表,從核心產品詞到長尾場景詞,覆蓋了幾十個細分領域。按照傳統做法,每個詞都需要一篇精心撰寫的文章。這直接導致了一個死循環:為了追求覆蓋度,我們不得不降低單篇內容的深度和投入;而內容質量的下滑,又反過來影響了排名和點擊率,很多文章發佈後就像石沉大海,只有個位數的月訪問量。

我意識到,問題可能不在於「寫多少」,而在於「寫什麼」和「怎麼寫」。我們開始分析那些排名靠前的頁面。一個明顯的共性是,它們很少是乾巴巴的功能介紹或定義解釋,而是解決了某個具體場景下的真實問題。比如,不是「什麼是邊緣運算」,而是「製造業生產線即時質檢,為什麼邊緣運算方案比雲端回傳更靠譜?」——後者有場景,有對比,有決策考量。

工具的角色:從「寫手」到「協作者」

觀念的轉變,需要工具的輔助。如果還是靠人力去一個個挖掘場景、構思角度、組織資料,效率瓶頸依然存在。這時,我們開始更系統地評估一些新一代的AI內容平台。我們需要的不是一個聽話的「寫手」,而是一個能理解SEO邏輯、能快速整合資訊、並能以符合搜尋意圖方式組織內容的「協作者」。

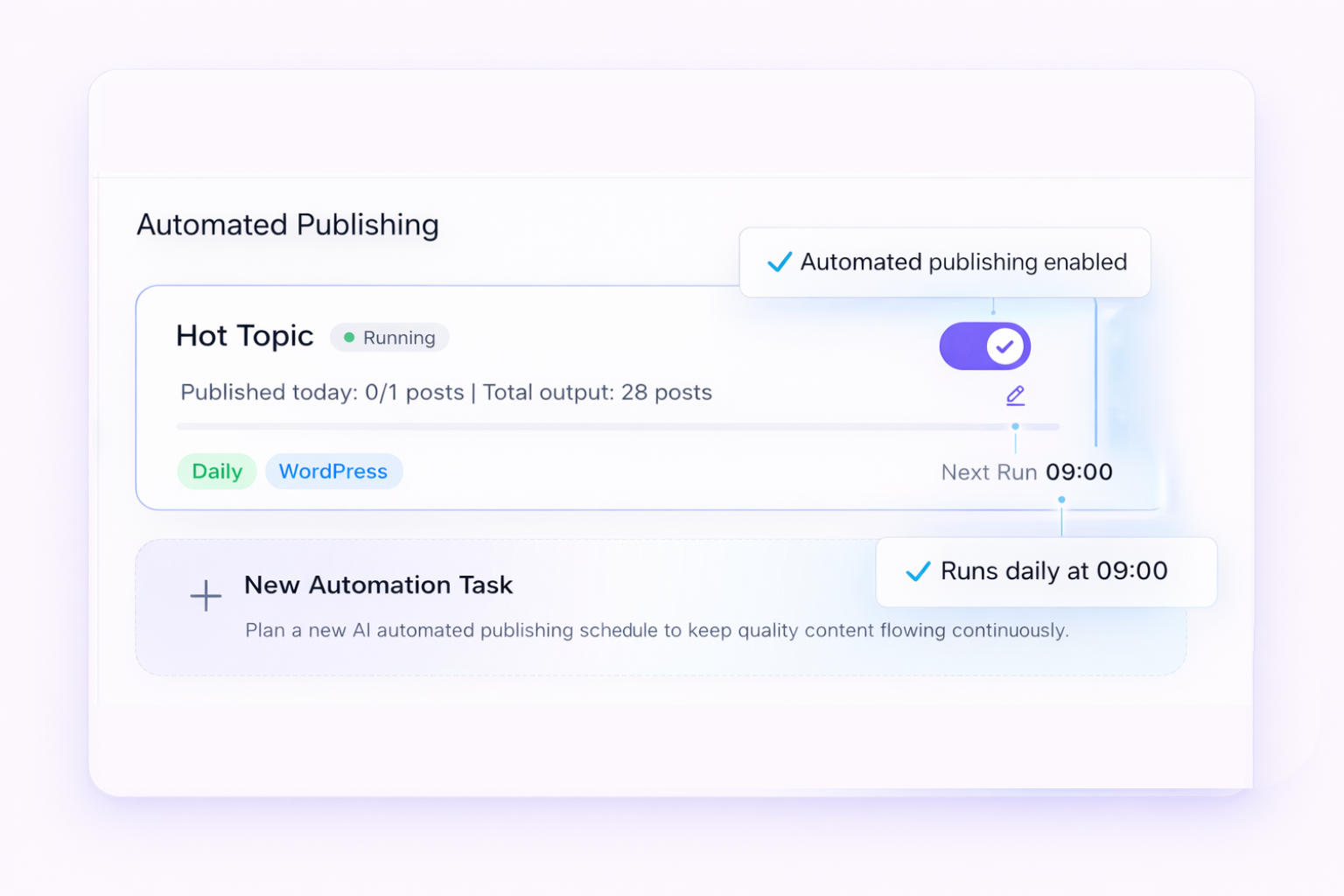

我們引入了SEONIB。它的切入點讓我覺得比較對路:它不是讓你憑空「創造」一個話題,而是讓你基於明確的關鍵字或內容源(比如一篇有價值的社交媒體討論、一個趨勢報告)去生成結構化的初稿。這很重要,這保證了內容的出發點是有真實搜尋需求或討論熱度的,而不是空中樓閣。

第一次使用的過程讓我印象挺深。我輸入了一個我們一直沒空寫的長尾技術關鍵字,選擇了「深度分析」的模板,並設定了相對專業的語調。生成的速度很快。我得到的不是一篇完整的、不容置喙的文章,而是一個骨架清晰、論點有待填充的草稿。它有引言,提出了問題,列出了幾個核心的論證方向,每個方向下有一些數據和案例的佔位符,最後有總結。更重要的是,它在右側提供了SEO優化建議,包括標題和元描述的改寫選項。

這解決了我最大的痛點:啟動阻力。面對一個空白文件,我常常需要花很多時間搭建結構。而現在,這個最耗時的步驟被前置解決了。我的工作變成了:審視這個結構是否符合邏輯,填充我知道的行業案例和數據,調整論述的側重點,讓語言更帶有我們團隊的實踐經驗色彩。SEONIB在這裡扮演的角色,更像一個高效的「第一作者」或「研究助理」,它負責搭台,我來唱戲。

意料之外的挑戰:內容同質化與「AI味」

很快,我們進入了批量生產的階段。效率確實上來了,一週能穩定產出幾十篇內容。但新的問題出現了:內容開始出現「模式化」的痕跡。雖然每篇文章的關鍵字不同,但論述的框架、轉折的句式、甚至舉例的套路,都有點似曾相識。我擔心,不僅讀者能看出來,搜尋引擎的演算法可能也會察覺到這種缺乏獨特性的內容。

這迫使我們在工作流中增加了一個新的環節:「人工注入洞察」。具體做法是,對於每一篇AI生成的初稿,我們要求負責的編輯或產品專家,必須加入至少一到兩個來自我們自身實踐中的具體觀察、踩過的坑、或是與主流觀點不同的看法。比如,在一篇講「微服務架構監控」的文章裡,我們不再滿足於羅列Prometheus、Grafana這些工具,而是加入了我們在某個客戶場景下,因為日誌採樣率設置不當導致的故障排查盲區,以及後來的解決方案。這一段內容完全是原創的、帶有體溫的。

另一個挑戰是「新鮮度」。AI基於既有資訊生成的内容,有時會缺乏對最前沿技術動態或市場變化的捕捉。我們養成了習慣,在發佈前,快速用幾個行業新聞源或技術博客RSS複查一下,確保文章裡沒有包含已經過時的版本號或被證偽的觀點。這個過程,SEONIB的快速編輯和翻譯功能幫上了忙,讓我們能高效地完成這些迭代。

流量與轉化的真實反饋:什麼內容真正奏效?

發佈不是終點。我們建立了簡單的監控看板,追蹤每篇內容的索引情況、排名變動和自然流量。幾個月下來,數據揭示了一些反直覺的結論:

- 並非越長越好:我們一度迷信2000字以上的深度文。但數據發現,一些針對非常具體、實操性問題(約800-1200字)的「精準解答型」文章,雖然篇幅不長,但排名穩定,用戶停留時間和轉化率(如下載、諮詢)反而更高。用戶要的是快速解決問題,不是通讀教科書。

- 關鍵字的「意圖」大於「熱度」:我們曾瘋狂追逐搜尋量大的熱門詞,但競爭太激烈,很難上位。後來我們更關注那些搜尋意圖明確(尤其是處在「決策階段」)的中低流量長尾詞。例如,對比「雲端運算」和「AWS Lambda vs. Azure Functions 成本測算」,後者的流量可能只有前者的零頭,但帶來的潛在客戶意向卻強烈得多。SEONIB在基於關鍵字生成內容時,如果能更精準地判斷並匹配搜尋意圖(是了解資訊、比較方案還是解決問題),效果會更好。

- 多媒體元素是留存的利器:我們實驗了在文章中插入流程示意圖、架構對比圖、甚至是簡短的GIF演示。使用了SEONIB內建的插圖生成和智能插入功能後,這個過程的成本降低了。數據清晰地顯示,包含這些相關插圖的頁面,平均會話時長有明顯提升。

未來的模糊地帶:原創性、權威性與AI的邊界

走到今天,我們的內容產出模式已經穩定為「AI生成初稿 + 人工深度編輯與洞察注入」。它解決了產能問題,也一定程度上保障了質量基線。但我心裡始終有一些未解的疑問,也是整個行業在2026年仍在摸索的:

- 原創性的閾值在哪裡? 當越來越多的競爭者使用相似的工具,基於相似的關鍵字和公開資料生成內容時,如何保持內容的差異性?我們依賴的「人工洞察」能形成足夠寬的護城河嗎?

- 搜尋引擎如何進化? Google等搜尋巨頭對AI生成內容的檢測和排序演算法一直在調整。它們是否會越來越傾向於獎勵那些能體現「經驗、專業、權威、可信」(E-E-A-T)中「經驗」部分的内容?而這恰恰是當前AI的短板。

- 內容的終極價值是什麼? 是為了獲取流量,還是為了建立品牌認知和信任?前者或許可以靠規模和效率,後者則必須依靠真正有價值、有觀點、有人味的溝通。我們的流程,在後者上投入的比例足夠嗎?

我沒有確切的答案。也許SEO內容的未來,不再是「寫文章」,而是「構建一個能持續回答用戶問題的、動態的經驗知識庫」。AI是構建這個知識庫的高效引擎,但引擎的燃料和導航系統,仍然來自於人類在真實世界中的實踐、思考和判斷。

FAQ

Q:用AI寫SEO文章,會被搜尋引擎懲罰嗎? A:就我們過去一年的實戰來看,只要內容最終能為用戶提供有價值的資訊,解決他們的問題,搜尋引擎目前並沒有單純的「AI生成」標籤並進行懲罰。關鍵在於內容質量本身,是否滿足搜尋意圖,是否具有資訊量和可讀性。完全未經編輯、充滿重複和空洞內容的AI文本,當然有風險。但經過人工校驗、增補洞察後的內容,在排名上表現正常。

Q:如何避免AI生成的内容千篇一律? A:我們核心方法是「輸入差異化」和「後期加工」。不要只輸入乾巴巴的關鍵字,可以輸入帶有觀點和場景的參考文章連結、社交媒體討論串,讓AI基於更有棱角的材料生成。最重要的是,生成後必須有人工環節,加入自己團隊獨有的案例、數據、失敗教訓或不同尋常的觀點。這是擺脫「AI味」的關鍵。

Q:什麼樣的文章最適合用AI輔助生成? A:根據我們的經驗,以下幾種類型效率提升最明顯:1) 針對明確關鍵字(尤其是長尾詞)的解答型、清單型文章;2) 行業基礎知識科普或術語解釋;3) 需要快速跟進的趨勢熱點初稿。而那些需要深度行業研判、大量獨家數據、或個人強烈觀點輸出的「思想領導力」文章,AI目前更多只能輔助資料整理。

Q:AI生成的内容,版權和原創度如何保障? A:這是一個需要謹慎對待的領域。負責任的做法是:使用工具時,選擇那些聲稱經過「乾淨數據」訓練並注重輸出原創性的服務。生成後,務必使用查重工具進行檢測。更重要的是,通過深度的人工編輯、重組和原創內容注入,顯著改變文本的最終形態,使其成為你的「衍生作品」。我們會在發佈前,確保內容的原創度達到一個自己設定的安全標準。

Q:你們現在的內容產出流程是怎樣的? A:簡化來說:1) 由SEO或產品團隊提供一批帶有明確搜尋意圖的關鍵字/主題。2) 使用SEONIB等工具,基於這些主題和提供的參考材料生成結構化的初稿。3) 編輯或領域專家接手,進行深度編輯:核實事實、更新數據、刪除冗餘、最重要的是加入至少1-2處來自自身實踐的獨家洞察或案例。4) 優化標題、描述和多媒體元素。5) 發佈並進入數據監控循環。