2026年了,SEO文章还需要自己写吗?我的实战观察与转折

我记得是去年年底,团队里的内容负责人又一次找我“谈心”。主题很老套:内容产出跟不上SEO需求,关键词库越积越多,但人力就那么多。我们试过扩招,试过外包,甚至试过让开发同事客串写手,结果要么成本飙升,要么质量滑坡。那感觉就像在跑步机上狂奔,但SEO的流量刻度盘却动得很慢。

当时我有个很固执的想法:AI写的东西,能看吗?更别说去跟那些深耕多年的独立站、权威媒体竞争排名了。我们试过一些早期的文本生成工具,出来的内容要么泛泛而谈,要么充满“正确的废话”,读起来像行业词典的拼接体,缺乏真正的洞察和说服力。用那种内容去投喂Google,感觉就像用塑料花去参加园艺大赛。

从“堆量”到“求质”的认知转变

最初的困境是量。我们有一份长长的关键词列表,从核心产品词到长尾场景词,覆盖了几十个细分领域。按照传统做法,每个词都需要一篇精心撰写的文章。这直接导致了一个死循环:为了追求覆盖度,我们不得不降低单篇内容的深度和投入;而内容质量的下滑,又反过来影响了排名和点击率,很多文章发布后就像石沉大海,只有个位数的月访问量。

我意识到,问题可能不在于“写多少”,而在于“写什么”和“怎么写”。我们开始分析那些排名靠前的页面。一个明显的共性是,它们很少是干巴巴的功能介绍或定义解释,而是解决了某个具体场景下的真实问题。比如,不是“什么是边缘计算”,而是“制造业生产线实时质检,为什么边缘计算方案比云端回传更靠谱?”——后者有场景,有对比,有决策考量。

工具的角色:从“写手”到“协作者”

观念的转变,需要工具的辅助。如果还是靠人力去一个个挖掘场景、构思角度、组织资料,效率瓶颈依然存在。这时,我们开始更系统地评估一些新一代的AI内容平台。我们需要的不是一个听话的“写手”,而是一个能理解SEO逻辑、能快速整合信息、并能以符合搜索意图方式组织内容的“协作者”。

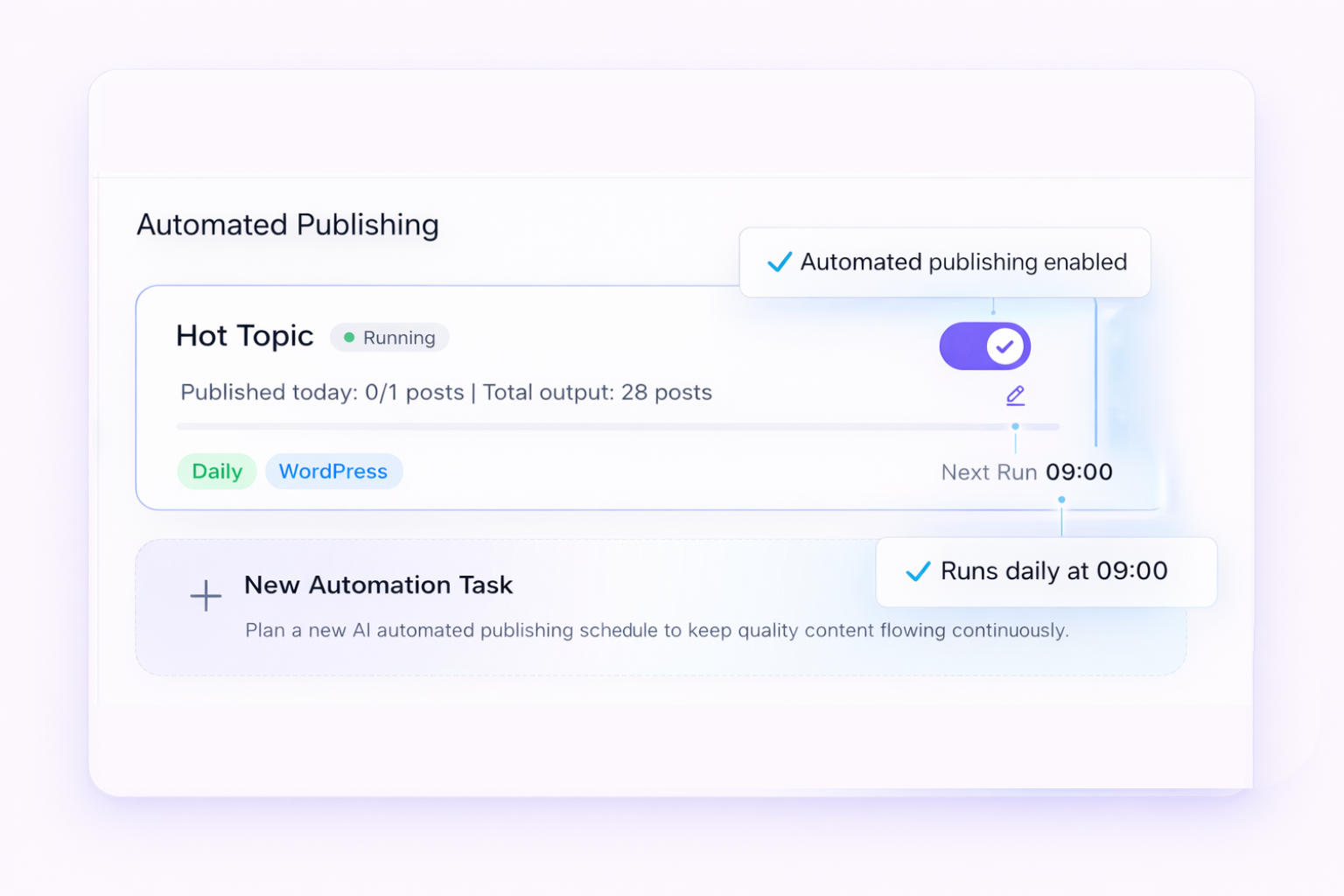

我们引入了SEONIB。它的切入点让我觉得比较对路:它不是让你凭空“创造”一个话题,而是让你基于明确的关键词或内容源(比如一篇有价值的社交媒体讨论、一个趋势报告)去生成结构化的初稿。这很重要,这保证了内容的出发点是有真实搜索需求或讨论热度的,而不是空中楼阁。

第一次使用的过程让我印象挺深。我输入了一个我们一直没空写的长尾技术关键词,选择了“深度分析”的模板,并设定了相对专业的语调。生成的速度很快。我得到的不是一篇完整的、不容置喙的文章,而是一个骨架清晰、论点有待填充的草稿。它有引言,提出了问题,列出了几个核心的论证方向,每个方向下有一些数据和案例的占位符,最后有总结。更重要的是,它在右侧提供了SEO优化建议,包括标题和元描述的改写选项。

这解决了我最大的一个痛点:启动阻力。面对一个空白文档,我常常需要花很多时间搭建结构。而现在,这个最耗时的步骤被前置解决了。我的工作变成了:审视这个结构是否符合逻辑,填充我知道的行业案例和数据,调整论述的侧重点,让语言更带有我们团队的实践经验色彩。SEONIB在这里扮演的角色,更像一个高效的“第一作者”或“研究助理”,它负责搭台,我来唱戏。

意料之外的挑战:内容同质化与“AI味”

很快,我们进入了批量生产的阶段。效率确实上来了,一周能稳定产出几十篇内容。但新的问题出现了:内容开始出现“模式化”的痕迹。虽然每篇文章的关键词不同,但论述的框架、转折的句式、甚至举例的套路,都有点似曾相识。我担心,不仅读者能看出来,搜索引擎的算法可能也会察觉到这种缺乏独特性的内容。

这迫使我们在工作流中增加了一个新的环节:“人工注入洞察”。具体做法是,对于每一篇AI生成的初稿,我们要求负责的编辑或产品专家,必须加入至少一到两个来自我们自身实践中的具体观察、踩过的坑、或是与主流观点不同的看法。比如,在一篇讲“微服务架构监控”的文章里,我们不再满足于罗列Prometheus、Grafana这些工具,而是加入了我们在某个客户场景下,因为日志采样率设置不当导致的故障排查盲区,以及后来的解决方案。这一段内容完全是原创的、带有体温的。

另一个挑战是“新鲜度”。AI基于既有信息生成的内容,有时会缺乏对最前沿技术动态或市场变化的捕捉。我们养成了习惯,在发布前,快速用几个行业新闻源或技术博客RSS复查一下,确保文章里没有包含已经过时的版本号或被证伪的观点。这个过程,SEONIB的快速编辑和翻译功能帮上了忙,让我们能高效地完成这些迭代。

流量与转化的真实反馈:什么内容真正奏效?

发布不是终点。我们建立了简单的监控看板,追踪每篇内容的索引情况、排名变动和自然流量。几个月下来,数据揭示了一些反直觉的结论:

- 并非越长越好:我们一度迷信2000字以上的深度文。但数据发现,一些针对非常具体、实操性问题(约800-1200字)的“精准解答型”文章,虽然篇幅不长,但排名稳定,用户停留时间和转化率(如下载、咨询)反而更高。用户要的是快速解决问题,不是通读教科书。

- 关键词的“意图”大于“热度”:我们曾疯狂追逐搜索量大的热门词,但竞争太激烈,很难上位。后来我们更关注那些搜索意图明确(尤其是处在“决策阶段”)的中低流量长尾词。例如,对比“云计算”和“AWS Lambda vs. Azure Functions 成本测算”,后者的流量可能只有前者的零头,但带来的潜在客户意向却强烈得多。SEONIB在基于关键词生成内容时,如果能更精准地判断并匹配搜索意图(是了解信息、比较方案还是解决问题),效果会更好。

- 多媒体元素是留存的利器:我们实验了在文章中插入流程示意图、架构对比图、甚至是简短的GIF演示。使用了SEONIB内置的插图生成和智能插入功能后,这个过程的成本降低了。数据清晰地显示,包含这些相关插图的页面,平均会话时长有明显提升。

未来的模糊地带:原创性、权威性与AI的边界

走到今天,我们的内容产出模式已经稳定为“AI生成初稿 + 人工深度编辑与洞察注入”。它解决了产能问题,也一定程度上保障了质量基线。但我心里始终有一些未解的疑问,也是整个行业在2026年仍在摸索的:

- 原创性的阈值在哪里? 当越来越多的竞争者使用相似的工具,基于相似的关键词和公开资料生成内容时,如何保持内容的差异性?我们依赖的“人工洞察”能形成足够宽的护城河吗?

- 搜索引擎如何进化? Google等搜索巨头对AI生成内容的检测和排序算法一直在调整。它们是否会越来越倾向于奖励那些能体现“经验、专业、权威、可信”(E-E-A-T)中“经验”部分的内容?而这恰恰是当前AI的短板。

- 内容的终极价值是什么? 是为了获取流量,还是为了建立品牌认知和信任?前者或许可以靠规模和效率,后者则必须依靠真正有价值、有观点、有人味的沟通。我们的流程,在后者上投入的比例足够吗?

我没有确切的答案。也许SEO内容的未来,不再是“写文章”,而是“构建一个能持续回答用户问题的、动态的经验知识库”。AI是构建这个知识库的高效引擎,但引擎的燃料和导航系统,仍然来自于人类在真实世界中的实践、思考和判断。

FAQ

Q:用AI写SEO文章,会被搜索引擎惩罚吗?

A:就我们过去一年的实战来看,只要内容最终能为用户提供有价值的信息,解决他们的问题,搜索引擎目前并没有单纯的“AI生成”标签并进行惩罚。关键在于内容质量本身,是否满足搜索意图,是否具有信息量和可读性。完全未经编辑、充满重复和空洞内容的AI文本,当然有风险。但经过人工校验、增补洞察后的内容,在排名上表现正常。

Q:如何避免AI生成的内容千篇一律?

A:我们的核心方法是“输入差异化”和“后期加工”。不要只输入干巴巴的关键词,可以输入带有观点和场景的参考文章链接、社交媒体讨论串,让AI基于更有棱角的材料生成。最重要的是,生成后必须有人工环节,加入自己团队独有的案例、数据、失败教训或不同寻常的观点。这是摆脱“AI味”的关键。

Q:什么样的文章最适合用AI辅助生成?

A:根据我们的经验,以下几种类型效率提升最明显:1) 针对明确关键词(尤其是长尾词)的解答型、清单型文章;2) 行业基础知识科普或术语解释;3) 需要快速跟进的趋势热点初稿。而那些需要深度行业研判、大量独家数据、或个人强烈观点输出的“思想领导力”文章,AI目前更多只能辅助资料整理。

Q:AI生成的内容,版权和原创度如何保障?

A:这是一个需要谨慎对待的领域。负责任的做法是:使用工具时,选择那些声称经过“干净数据”训练并注重输出原创性的服务。生成后,务必使用查重工具进行检测。更重要的是,通过深度的人工编辑、重组和原创内容注入,显著改变文本的最终形态,使其成为你的“衍生作品”。我们会在发布前,确保内容的原创度达到一个自己设定的安全标准。

Q:你们现在的内容产出流程是怎样的?

A:简化来说:1) 由SEO或产品团队提供一批带有明确搜索意图的关键词/主题。2) 使用SEONIB等工具,基于这些主题和提供的参考材料生成结构化的初稿。3) 编辑或领域专家接手,进行深度编辑:核实事实、更新数据、删除冗余、最重要的是加入至少1-2处来自自身实践的独家洞察或案例。4) 优化标题、描述和多媒体元素。5) 发布并进入数据监控循环。